在 VS Code 中使用 oMLX 本地模型,主要依赖于 oMLX 提供的 OpenAI / Anthropic 兼容 API 接口,通过配置 VS Code 的 AI 插件(如 Continue、Copilot Chat 等)连接到 oMLX 本地服务。

✅ 核心步骤

- oMLX 仅支持 macOS + Apple Silicon(M1/M2/M3/M4/M5),不支持 Windows 或 NVIDIA 显卡 。

- oMLX 启动后默认提供以下 API 接口:

- OpenAI 兼容:

http://localhost:8000/v1 - Anthropic 兼容:

http://localhost:8000

- OpenAI 兼容:

🛠️ 在 VS Code 中配置 oMLX 的方法

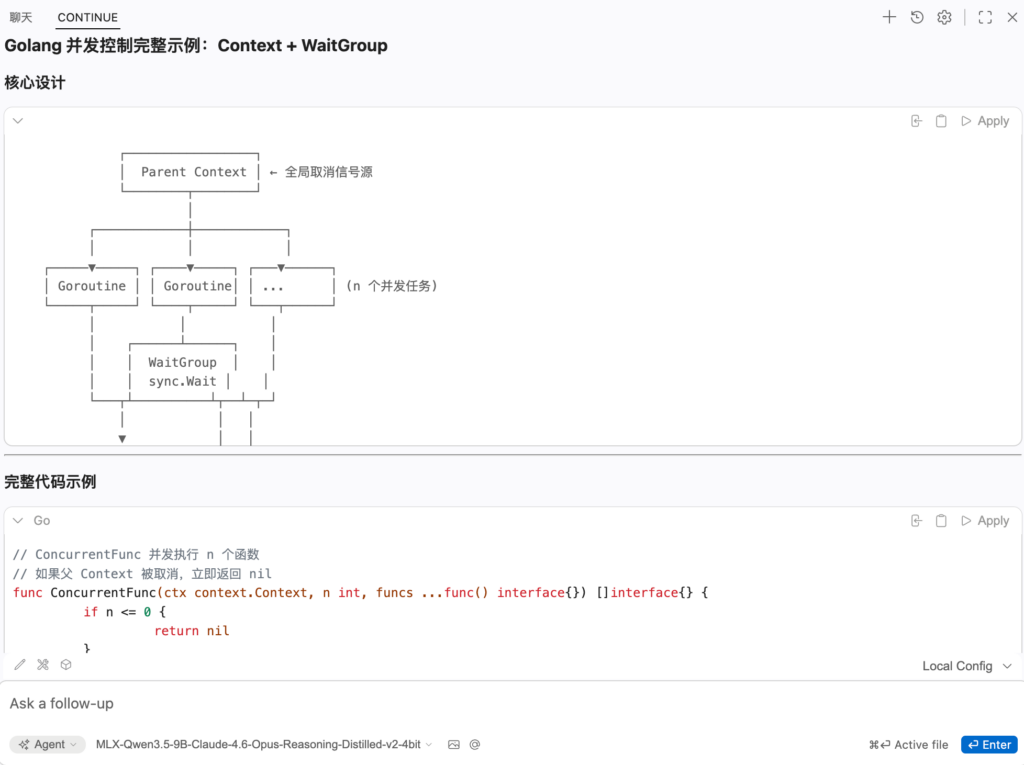

一:使用 Continue 插件(推荐)

- 安装 Continue 插件

- 打开 VS Code → 扩展市场 → 搜索

Continue→ 安装 。

- 打开 VS Code → 扩展市场 → 搜索

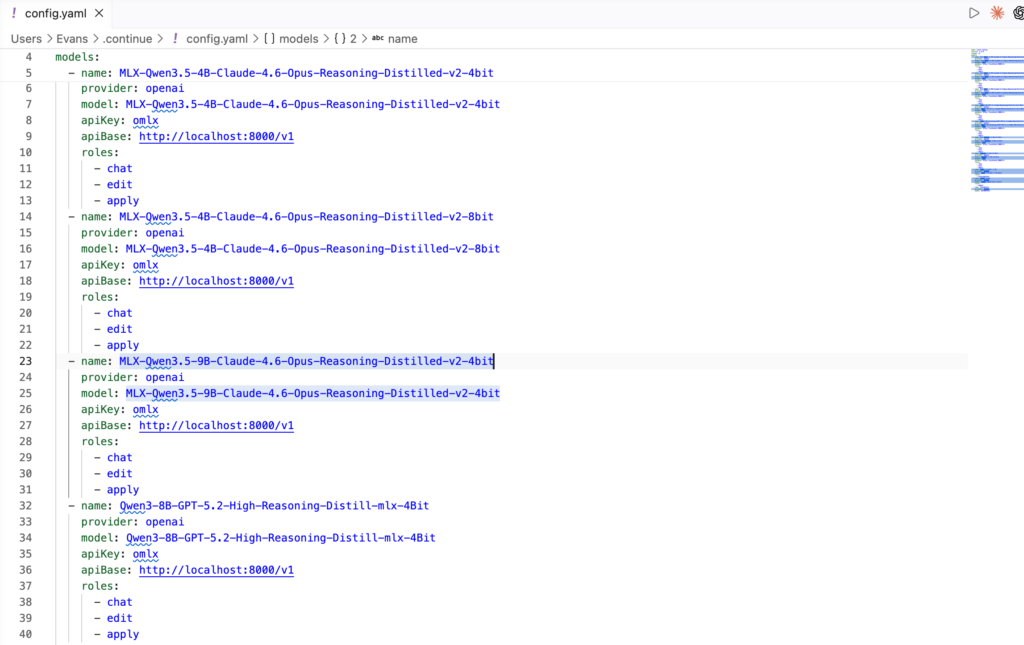

- 配置本地模型

- 打开 VS Code 设置(

Cmd+,)→ 搜索Continue。 - 在

Continue: Models中添加如下配置: - 重启 VS Code 或重新加载 Continue。

- 打开 VS Code 设置(

models:

- name: MLX-Qwen3.5-9B-Claude-4.6-Opus-Reasoning-Distilled-v2-4bit

provider: openai #一定要设置成openai

model: MLX-Qwen3.5-9B-Claude-4.6-Opus-Reasoning-Distilled-v2-4bit #这里改成本地使用的模型

apiKey: omlx #这里改成本地omlx设置的apikey

apiBase: http://localhost:8000/v1 #这里改成OMLX中API 端点OpenAI API的地址即可

roles:

- chat

- edit

- apply

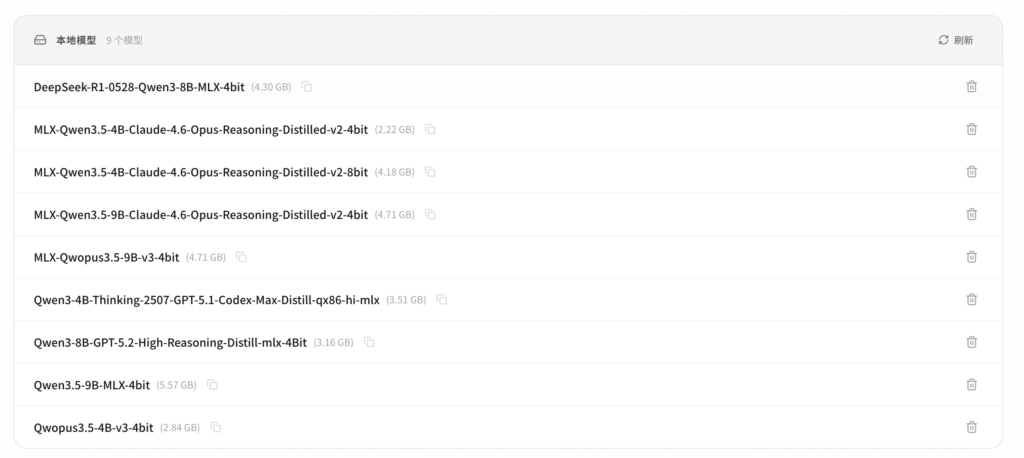

- 启动 oMLX 服务

- 确保 oMLX 已在终端或菜单栏中运行,并已加载目标模型 。

- 使用

- 在 VS Code 编辑器中右键 → 选择

Continue: Chat、Agent 或按快捷键(默认Cmd+I)即可调用本地模型。

- 在 VS Code 编辑器中右键 → 选择

✅ 优势:完全离线、代码不上传云端、支持工具调用与结构化输出 。

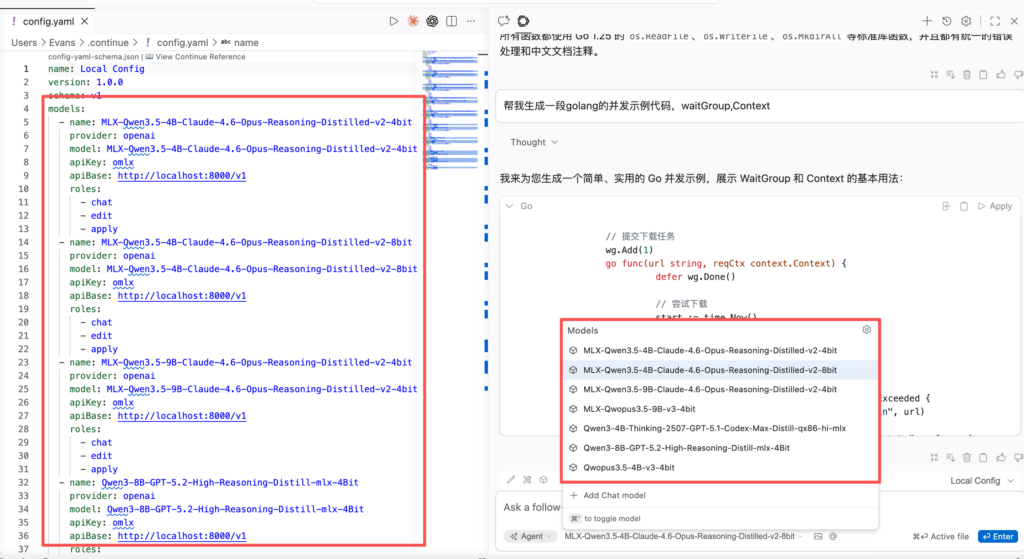

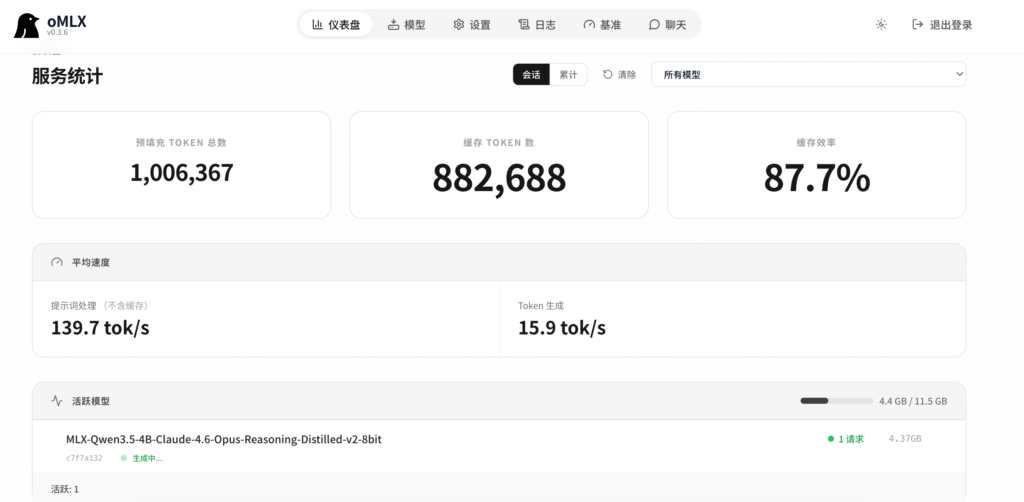

本地使用截图,能用,够用(M2 16G+512G的macbook pro,请忽略token生成的速度):

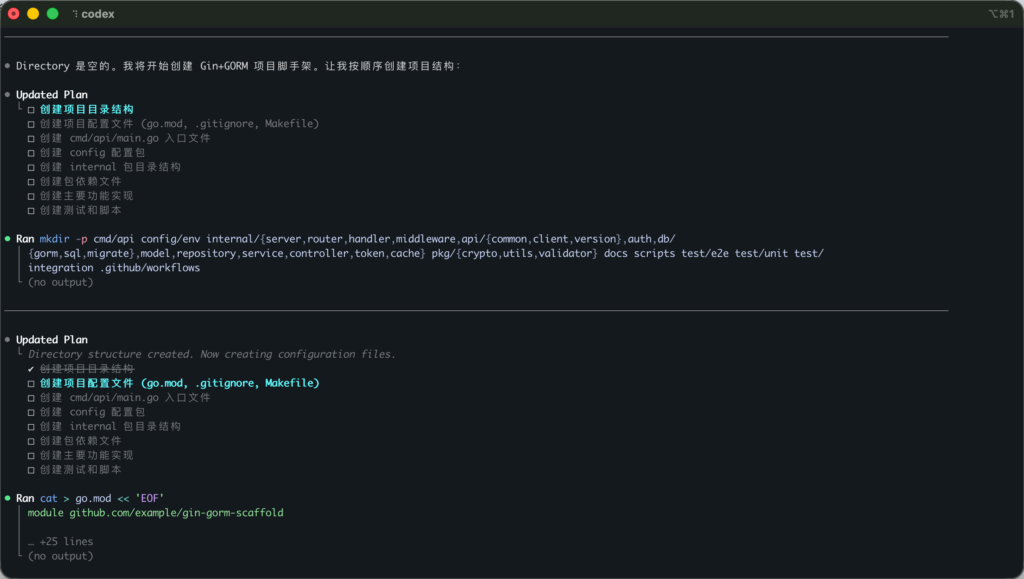

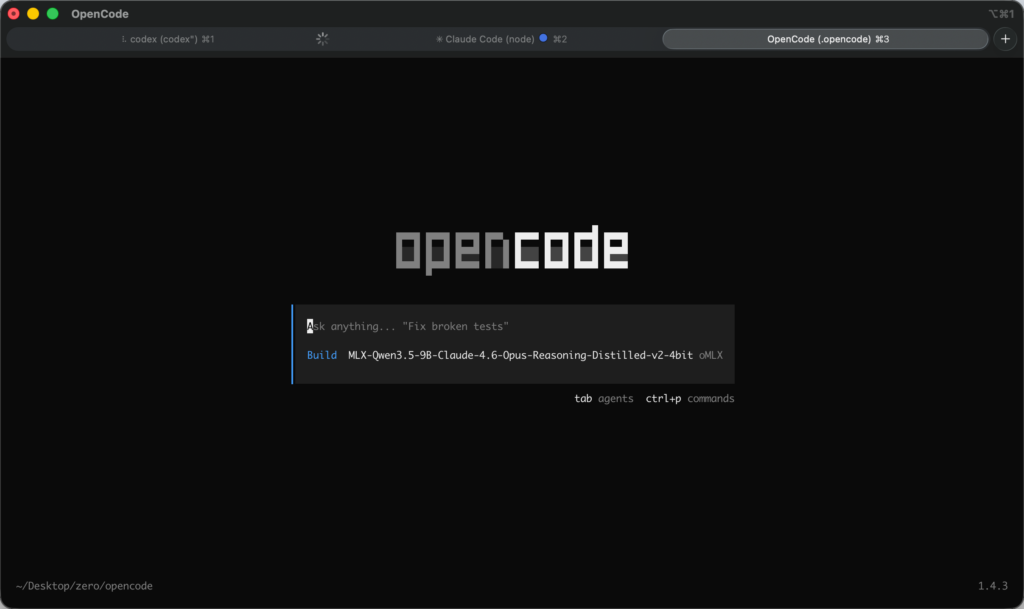

集成 Claude Code / Codex/OpenCode/OpenClaw

oMLX 提供一键配置生成器,简化了与主流开发工具的集成:

- 打开 Web 管理面板 (http://localhost:8000/admin)

- 选择要使用的模型

- 点击 “Integrations” 选项卡

- 一键复制配置命令

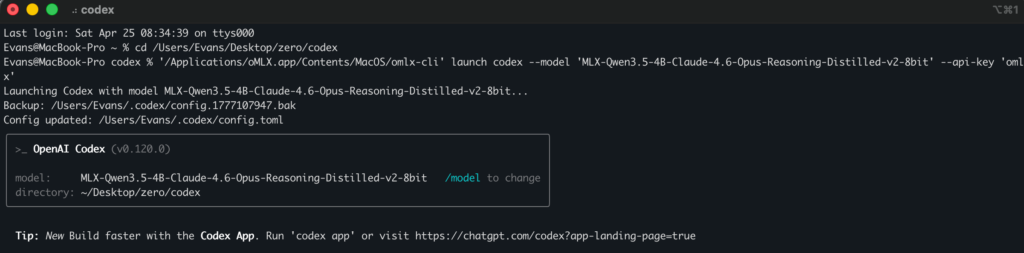

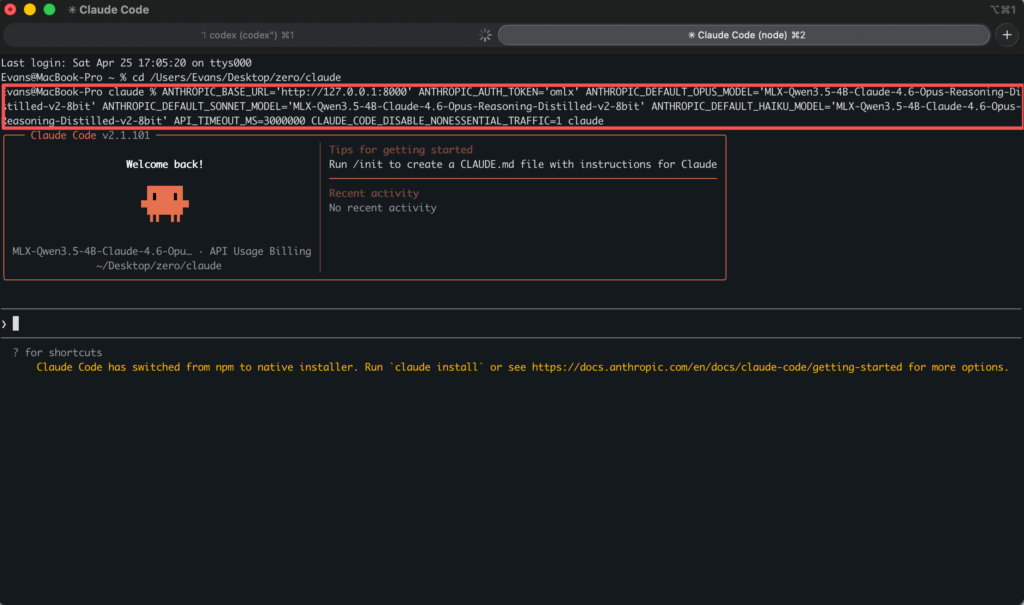

- 打开命令行,cd进入需要处理的项目文件夹,对应的命令 回车就可以啦,如codex和claude code的启动命令

'/Applications/oMLX.app/Contents/MacOS/omlx-cli' launch codex --model 'MLX-Qwen3.5-4B-Claude-4.6-Opus-Reasoning-Distilled-v2-8bit' --api-key 'omlx'ANTHROPIC_BASE_URL='http://127.0.0.1:8000' ANTHROPIC_AUTH_TOKEN='omlx' ANTHROPIC_DEFAULT_OPUS_MODEL='MLX-Qwen3.5-4B-Claude-4.6-Opus-Reasoning-Distilled-v2-8bit' ANTHROPIC_DEFAULT_SONNET_MODEL='MLX-Qwen3.5-4B-Claude-4.6-Opus-Reasoning-Distilled-v2-8bit' ANTHROPIC_DEFAULT_HAIKU_MODEL='MLX-Qwen3.5-4B-Claude-4.6-Opus-Reasoning-Distilled-v2-8bit' API_TIMEOUT_MS=3000000 CLAUDE_CODE_DISABLE_NONESSENTIAL_TRAFFIC=1 claude